文/王晟

(作者王晟,荔枝新闻特约评论员;本文系荔枝新闻客户端、荔枝网独家约稿,转载请注明出处。)

进入10月的这几天,人工智能再次亮出了双刃剑。

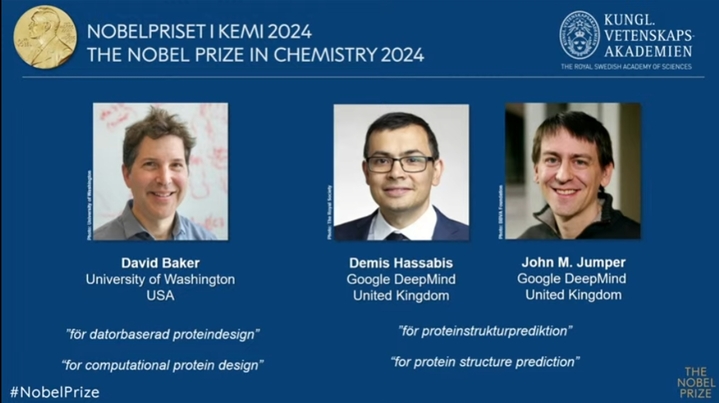

一面是凭借为人工智能奠定理论基础、用AI模型精准预测蛋白质复杂精妙的结构,几位科学家分获诺贝尔物理学奖和诺贝尔化学奖。

图源:诺贝尔官网

另一面,则是黄金周期间出现大量AI配音的冒牌“雷军”,在短视频平台上“怼天骂地”,对调休、堵车等话题犀利点评还爆粗口。

从AI推动科学探索到AI造假恶搞传播,人工智能的安全性和伦理问题又一次引发关注,AI这柄双刃剑,究竟该如何在使用与监管中把握平衡?

很多人工智能领域的先驱都曾获得图灵奖。这个奖项通常被比作计算机领域的诺贝尔奖。而今年的诺贝尔奖直接“抢戏”,褒奖了在人工智能理论奠基和探索应用方面建功卓著的科学家。有评论认为,这次诺奖对AI技术的肯定,凸显了AI作为科学研究“助手”的强大潜力。

人工智能善于处理海量数据、发现复杂规律,帮助研究人员进行前沿突破。比如AI已经被应用于癌症筛查、基因分析、药物研发等关键领域,极大加速了医学研究的进展,展示了它在改善人类健康福祉方面的广阔前景。

而AI伪造出的假冒“雷军”们,则在警告我们:AI的创造力与风险并存。人工智能生成技术近两年突飞猛进,在图像、音视频生成和信息传播中有着令人惊叹的巨大潜力,同时也带来了真假难辨的巨大风险,很容易成为不法分子操控和误导公众的工具。

如果说当年文字配图的大量“鲁迅说”还是移花接木的1.0版本,今天直接让某位公众人物用几乎天衣无缝的声音、口型、形象、动作进行“名人说”,恐怕已经是3.0、4.0的高阶版本。

在这个信息爆炸的时代,如何甄别真伪,防范虚假信息的传播,本就是各国正在头痛的治理难题,当AI技术进场加持,只会让“后真相”变成更为艰巨的挑战。

AI造假并非新鲜事,但是当其恶意利用的成本不断降低,威胁则愈发增强。AI造假不仅仅与个人隐私和名誉问题有关,更关乎公众信任和社会的基本秩序。科技的进步本应为社会带来便利,但如果被恶意使用,势必产生负面影响。如何有效防范和管理其负面效应,是一个亟需解决的问题。

为了用法律对AI技术应用加以规范,欧盟已经陆续出台了《人工智能法案》《一般数据保护条例》《数字服务法案》等一系列法规。我国《网络安全法》《数据安全法》《个人信息保护法》等法规也已陆续颁布执行。2023年8月15日起,国家网信办等七部门联合公布并施行的《生成式人工智能服务管理暂行办法》,专门对侵害个人信息权益的人工智能进行责任界定。

今年9月14日,国家互联网信息办公室就《人工智能生成合成内容标识办法(征求意见稿)》公开征求意见,旨在“规范人工智能生成合成内容标识,维护国家安全和社会公共利益,保护公民、法人和其他组织的合法权益”。

也就是说,AI内容生成可以应用在在娱乐、教育等领域,但是在传播中必须加以明确标识,防止人工智能变成加了氪金装备的人工欺诈。

加强对AI生成内容的识别与标定,也算是用技术迎战技术,用魔法打败魔法。

今年颁发诺贝尔物理学奖的过程中,也提到了要对AI技术加以肯定,更要重申科技伦理与责任的重要性。在享受科技突破带来的便利时,我们不能忽视科技滥用的风险。正如获奖者杰佛里·辛顿说的,科技界与社会必须共同思考,如何在推动AI技术进步的同时,确保它被负责任地使用。

对了,这句话是他本人获奖后的亲口回应,并非AI生成。

欢迎关注荔枝锐评(lizhirp)公众号:

公安备案号:32010202010067

公安备案号:32010202010067